こんにちは。SB C&Sの山田です。

今回は、VCF 9.0 / VVF 9.0(vSphere 9.0)でGAとなった Memory Tiering について紹介します。

近年、AI ワークロードの拡大に伴い、サーバー調達の課題がこれまで以上に顕在化しています。特に深刻なのが、ハードウェア価格の高騰と供給不足です。

これまでであれば、「メモリ(DRAM)が足りなければ増設する」という比較的シンプルな対応が可能でした。しかし現在は、必要なタイミングで必要な容量を確保することが難しく、加えてコストも大きく膨らみやすい状況にあります。

こうした背景の中で注目されるのが、vSphere 9.0 で提供される Memory Tiering です。この機能は、高価な DRAMだけに依存するのではなく、NVMe SSD を第2階層メモリとして活用することで、コストを抑えながら実効的なメモリ容量を拡張できる仕組みです。

なぜ今、Memory Tiering が注目されるのか

背景にあるのは、AI 需要を中心としたハードウェア市場の変化です。大規模データセンターやAIインフラの構築が世界中で進む中、サーバー向け部材、特にメモリ需要が急増しています。その結果として起きているのが、「DRAM 価格の上昇」と「調達リードタイムの長期化」です。

これは単に「高い」だけではなく、欲しいときにすぐ手に入らないという状況を招いています。加えて、実際には CPU より先にメモリがボトルネックになるケースが多いかとおもいます。CPU にはまだ余力があるのに、メモリ不足のために VM を増やせない、あるいは新しいワークロードを載せられない、という状態です。

このような環境では、サーバーの CPU リソースを十分に使い切れず、結果としてインフラ全体の資源効率も悪くなってしまいます。

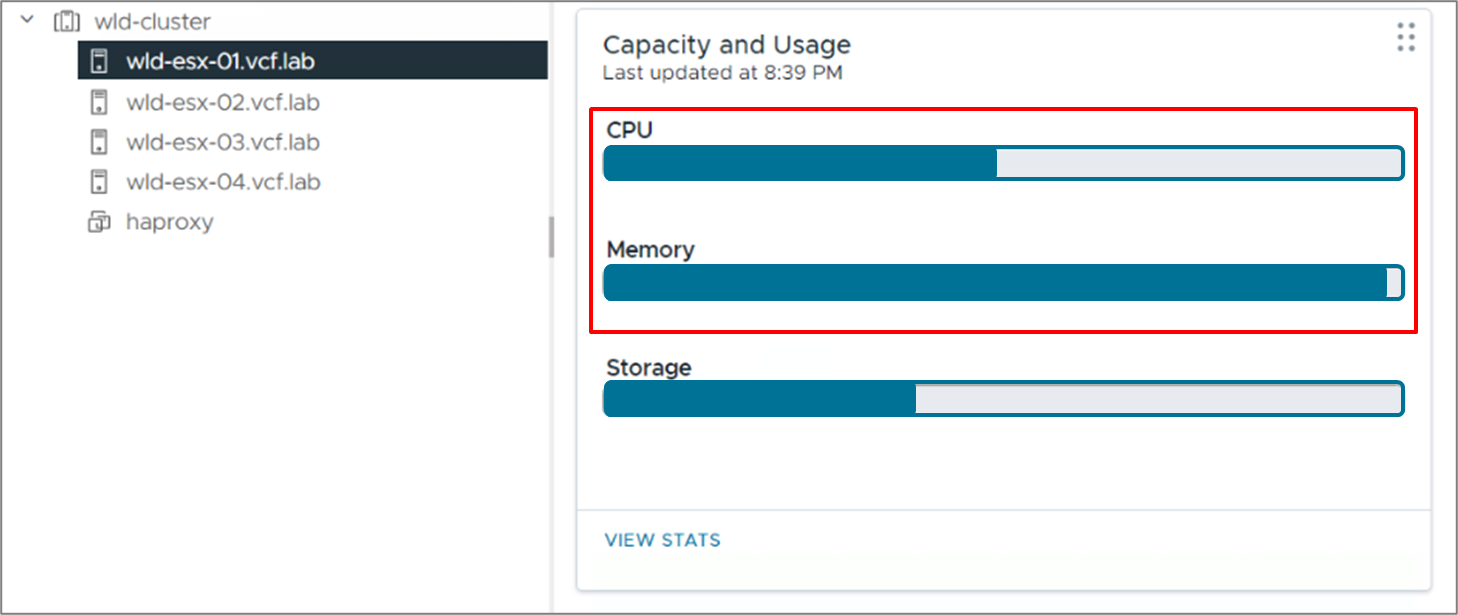

Memory Tiering とは何か

Memory Tiering を一言で表すと、

「速いメモリ(DRAM)と安いメモリ(NVMe)を組み合わせて使う仕組み」です。

従来は、すべてのメモリを高価な DRAM で用意する必要がありました。しかし Memory Tiering では、メモリを次のように階層化して使います。

Tier 0:DRAM(高速・高価)

Tier 1:NVMe(低速・安価)

そしてデータの使われ方に応じて、

よく使うデータ → DRAM

あまり使わないデータ → NVMe

という形で自動的に処理が振り分けられます。

このTier-0 デバイスの容量(DRAM)と 、Tier-1 デバイスの容量(NVMe)の合計値がメモリ資源として扱われます。

これにより、コストを抑えながら、実質的なメモリ容量を増やすことができます。

重要なのは、この仕組みがアプリケーションからは見えない(透過的)という点です。アプリ側での変更は不要で、vSphere が裏側で自動的に最適化を行います。

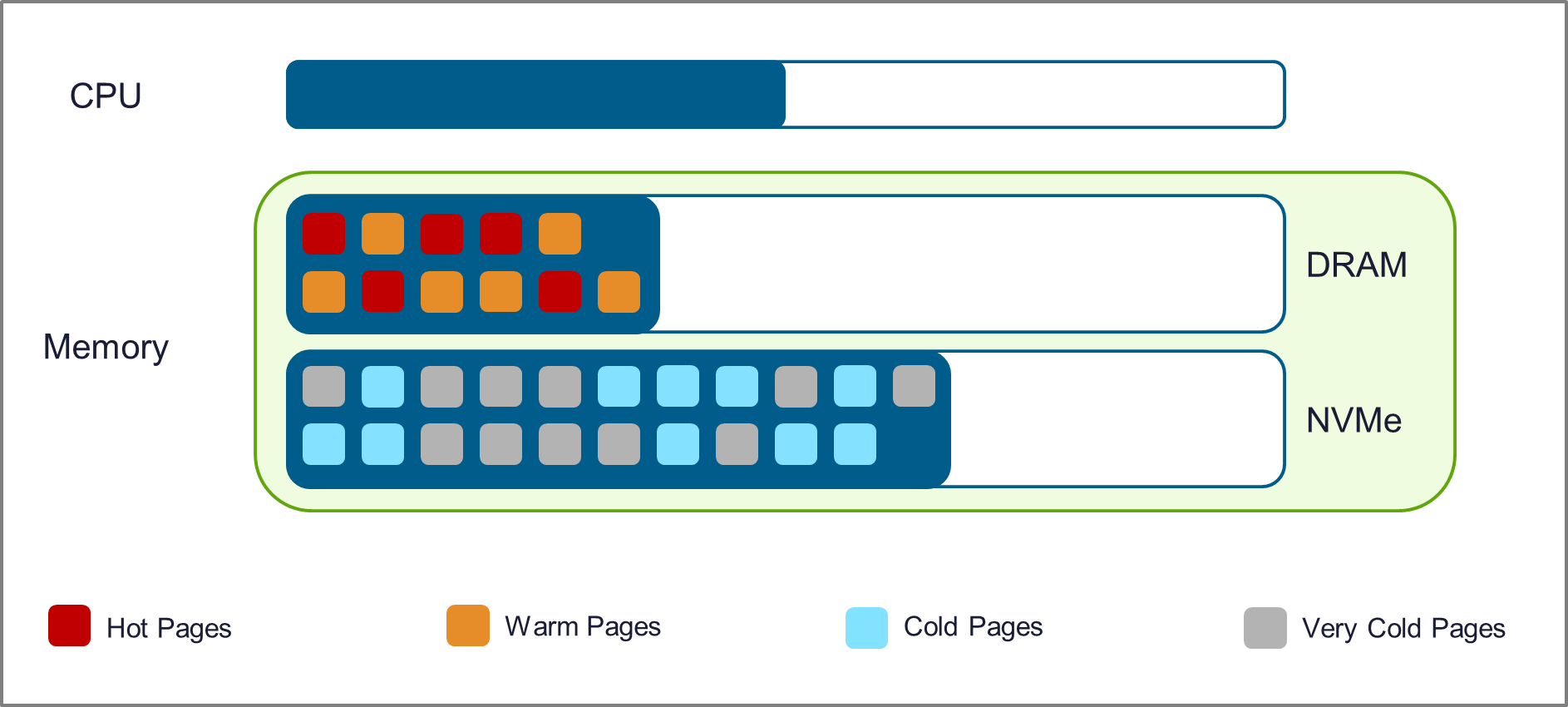

データはどのように振り分けられるのか

Memory Tiering では、メモリの中身(ページ)を利用頻度に応じて分類しています。

- Hot page:頻繁に使われる → DRAM に配置

- Warm page:そこそこ使われる → DRAM に配置

- Cold page:あまり使われない → NVMe へ移動

- Very Cold page:ほとんど使われない → NVMe へ移動

イメージとしては、「よく使うものは机の上に置き、あまり使わないものは引き出しにしまう」のに近い考え方です。すべてを机の上(DRAM)に置く必要はなく、本当に必要なものだけを高速な領域に置けばよい、という設計です。

ポイントは、すべてのデータが高速である必要はないという点です。

実際のワークロードでは、常に使われるデータ(Hot)は一部、多くのデータは断続的 or ほぼ未使用という傾向があります。そのため、高速な DRAM は「必要な分だけ」に集中させ、それ以外は安価な NVMe に逃がすことで、コストと性能のバランスを最適化できます。

どれくらい効果があるのか?

Memory Tiering の価値は、「仕組み」そのものよりも、実際にどれだけの「メリット」をもたらすかにあると考えています。VMware が公開している以下のブログでは、検証結果や実環境での事例に基づき、その効果が報告されています。

Smarter Infrastructure Starts Here: Drive Cost Savings and Consolidation with Memory Tiering:

https://blogs.vmware.com/cloud-foundation/2025/06/19/smarter-infrastructure-starts-here-drive-cost-savings-and-consolidation-with-memory-tiering/

コスト削減:最大40%の TCO 削減

高価な DRAM の使用量を削減し、比較的安価な NVMe で代替することで、サーバー単体だけでなく、ラックスペースや電力を含めた全体コストの削減につながります。

メモリ容量の拡張:DRAM + NVMe により最大4倍のメモリ拡張

デフォルトでは DRAM:NVMe = 1:1 の構成が推奨されていますが、ワークロードによっては 1:4 の構成も可能です。これにより、物理的な DRAM を増設せずに、実効的なメモリ容量を大幅に拡張できます。

CPU リソースの有効活用

メモリ不足によって発生していた「VM の追加制限」、「ワークロードの配置制約」が緩和されることで、CPU リソースの未使用状態(アイドル)が解消されるという副次的なメリットも大きいポイントです。

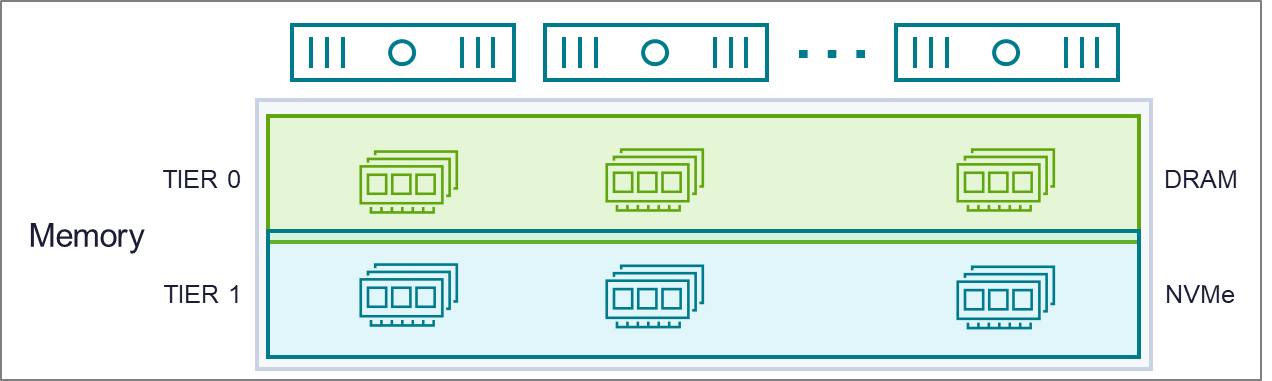

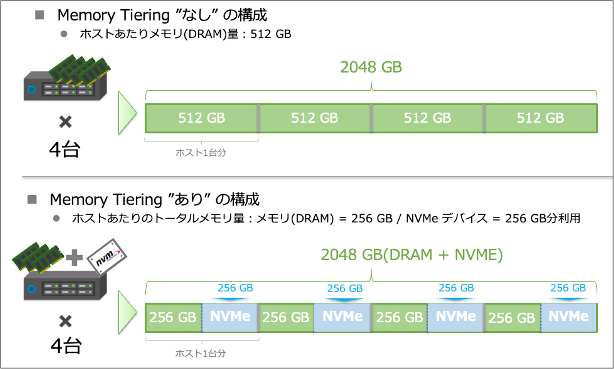

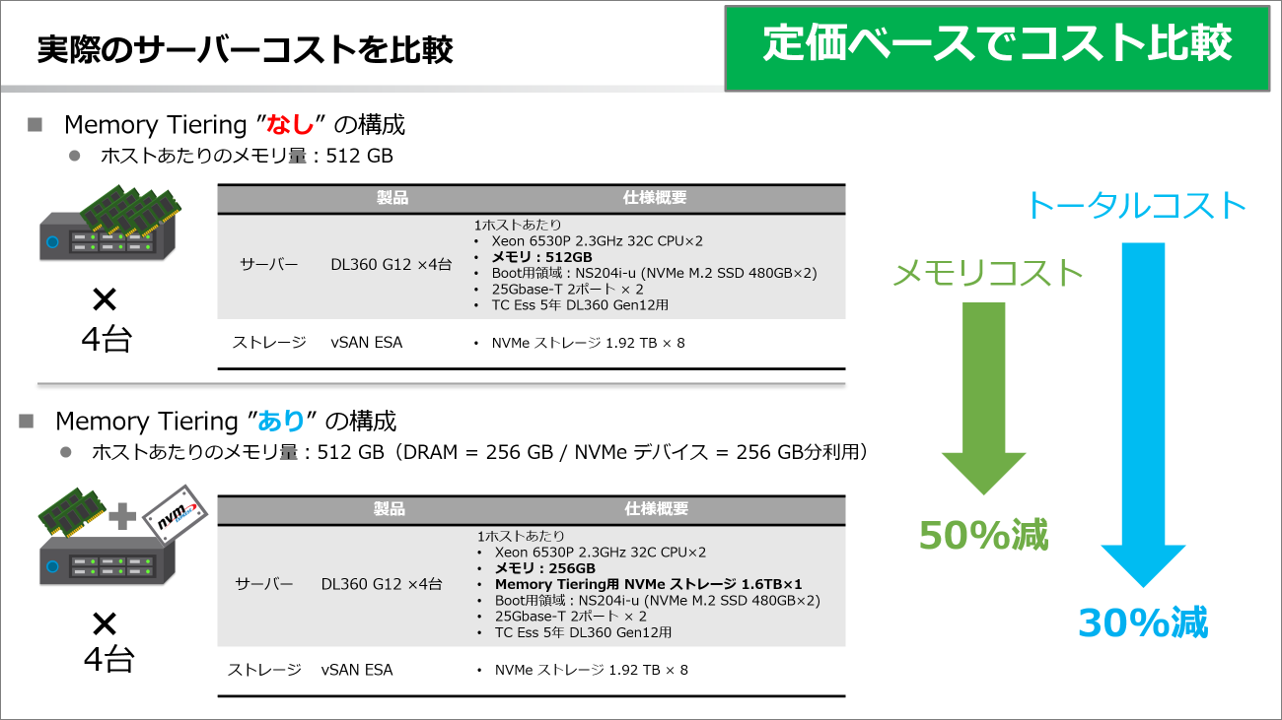

実際に見積を作成し比較してみる

実際にどの程度コストに差が出るのか気になる方も多いと思います。そこで今回は、同一条件で「Memory Tiering あり / なし」の構成で簡易的な見積比較を行ってみました。なお、比較した際の価格は定価ベースになります。

比較条件

今回の比較では、以下の条件を揃えています。

- サーバー台数:4台

- CPU 構成:同一

- ストレージ構成:同一(vSAN ESA)

違いはメモリ構成のみです。

Memory Tiering なしの構成

- ホスト1台あたりのメモリ:512 GB(すべて DRAM)

従来通り、必要なメモリをすべて DRAM で構成するパターンです。

Memory Tiering ありの構成

- ホスト1台あたりのメモリ:512 GB相当

- DRAM:256 GB

- NVMe:256 GB(メモリ領域の Tier1 として利用)

DRAM の容量を半分に抑え、その分を NVMe で補う構成としています。

なお、この構成では各ホストに NVMe デバイスを追加しており、ハードウェア数としては増えている状態です。

比較結果

上記の構成で比較したところ、以下の結果になりました。

- メモリコスト:約50%削減

- トータルコスト:約30%削減

各ホストに NVMe を追加しているにもかかわらず、全体コストは下がっています。これは、DRAM と NVMe の価格差によるものです。

- DRAM:高価

- NVMe:比較的安価

このため、DRAM を削減して NVMe で補うことで、NVMe の追加コストを含めたとしても、結果としてトータルコストを抑えることができます。

※NVMe ストレージも価格が高騰しておりますが、トータルコストでみると上記の結果でした。

パフォーマンス特性

ここまで様々なメリットをご紹介してきましたが、一方パフォーマンスの観点で、「NVMe にオフロードして性能が劣化しないのか?」と気になる方が多いと思います。

VMware が公開している検証結果では、Memory Tiering は単純な性能比較ではなく、VM 密度を増やした状態での性能維持という観点で評価されています。

具体的には以下のような結果が報告されています。

- VDI:VM 密度を2倍に増加、性能低下は 0〜8%

- エンタープライズアプリ:VM 密度を2倍に増加、約 5% の低下

- データベース:VM 密度を2倍に増加、5〜10% 程度の性能低下

つまり、「わずかな性能低下で、より多くのワークロードを収容できる」と評価されており、ユーザー体感ではほとんど差を感じることはないということがわかります。

また、以下の公式ブログ・資料でも詳細なベンチマークが公開されておりますので是非ご確認ください。

Memory Tiering Performance in VMware Cloud Foundation 9.0:

https://blogs.vmware.com/cloud-foundation/2025/07/17/memory-tiering-performance-in-vmware-cloud-foundation-9-0/

Memory Tiering Performance: VMware Cloud Foundation 9.0:

https://www.vmware.com/docs/memtier-vcf9-perf

Memory Tiering を利用するための要件

ここまで読まれて、「実際に自分の環境でも使えるのか?」と気になった方も多いと思います。

Memory Tiering は比較的シンプルに導入できる機能ですが、いくつかの前提条件があります。ここでは、導入前に押さえておきたいポイントを整理します。

バージョン要件

まず、利用するためには以下のバージョンが必要です。

- vCenter:9.0 以降

- ESX:9.0 以降

vSphere 9.0 環境が前提となります。

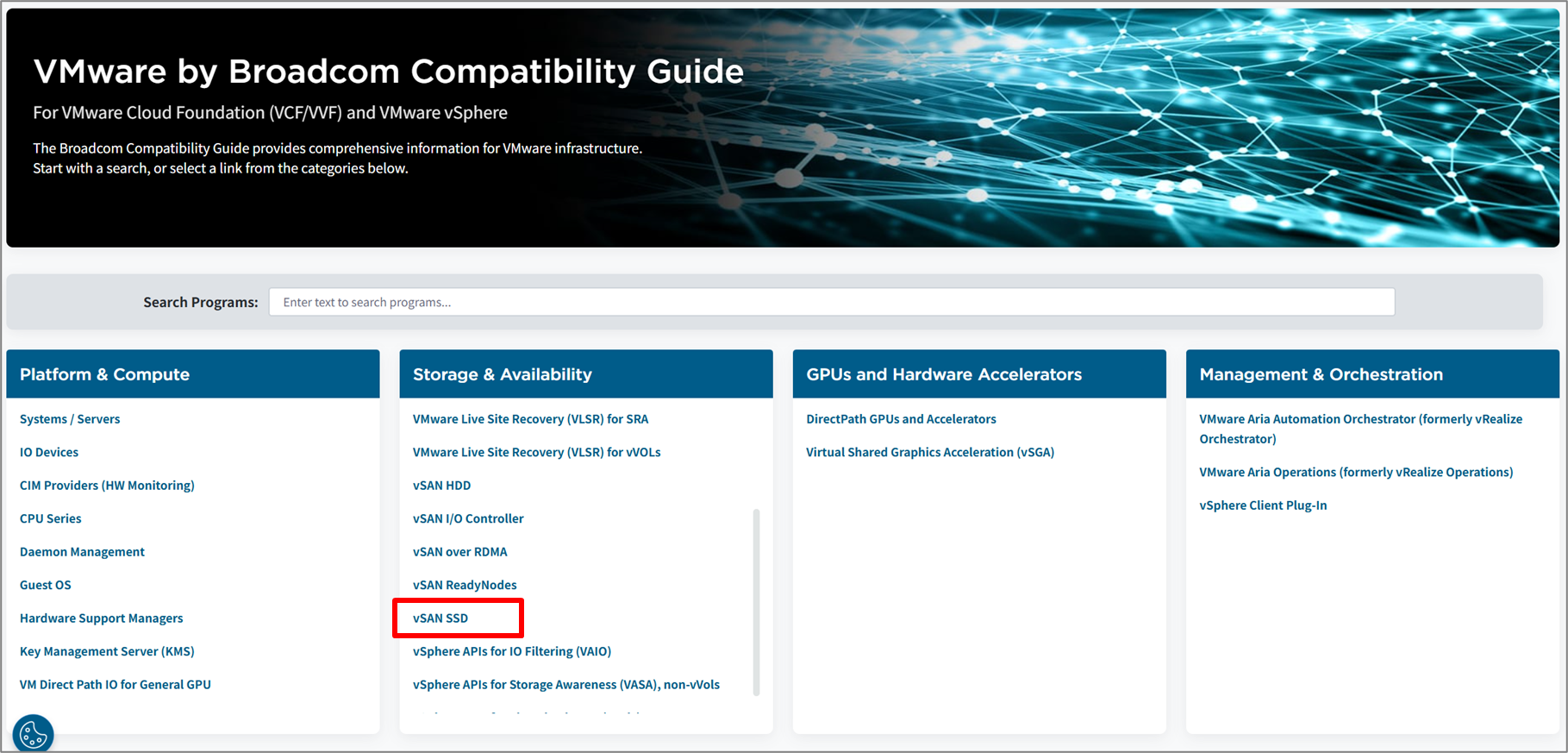

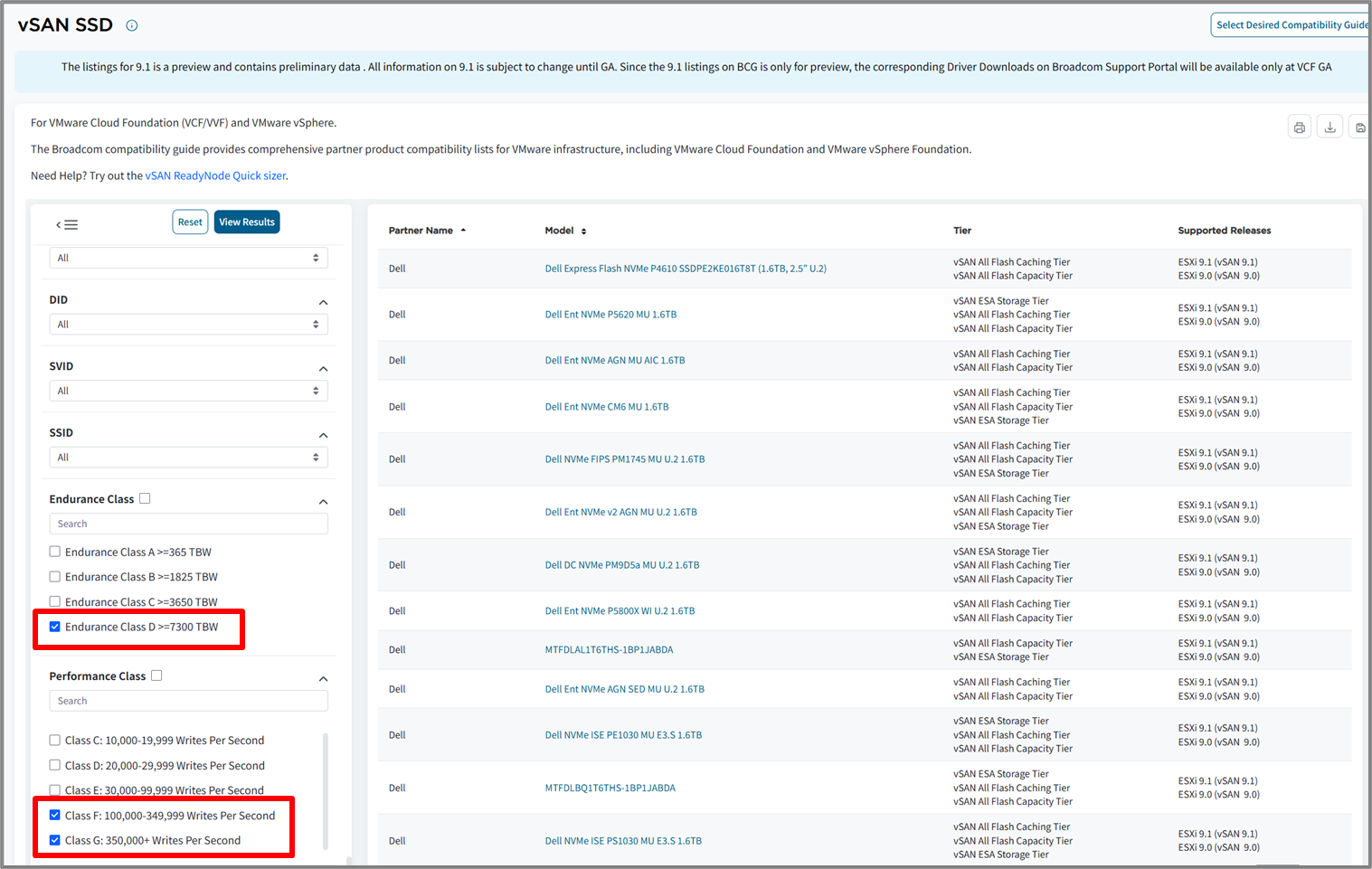

NVMe デバイス要件

Memory Tiering はすべての NVMe デバイスで使用できるわけではありません。Broadcom の Compatibility Guide の「vSAN SSD」に掲載されている一部のデバイスが対象です。

掲載されているデバイスの中で Memory Tiering に必要な要件は以下です。

- デバイスの種類:NVMe

- 耐久性:Endurance Class D 以上

- 性能:Performance Class F または G

「vSAN SSD」の画面にて、上記の要件を設定してフィルタリングを行うと対象デバイスを探しやすくなります。

また、利用方法にも注意点があります。注意点としては下記になります。

- ESX ホストにローカル接続されていること

- vSAN や VMFS と共有不可(専用利用)

- メモリ用途として利用できるのは最大 4TB

用途に合ったNVMeを選定することがポイントです。

ホスト / クラスタの要件

ホストおよびクラスタ側のポイントは以下の通りです。

- 有効化時はメンテナンスモード移行+再起動が必要

- Intel Optane / NVDIMM は対象外

- クラスタ全体での有効化が推奨(ホスト単位でも設定可能)

まずは一部ホストで検証し、その後全体展開するのがおすすめです。

仮想マシンの要件

仮想マシン側については、基本的に追加設定は不要です。ホスト上のVMは自動的に Memory Tiering の対象になります。ただし、以下のような構成はサポート対象外となります。

- 低遅延設定(Latency Sensitive)を有効にしている VM

- PCI Passthrough を使用している VM

- Fault Tolerance(FT)を利用している VM

- Nested 構成の VM

一般的な業務VMであれば、ほぼそのまま利用可能です。

既存 vSphere 機能との互換性

Memory Tiering は、vSphere の既存機能とシームレスに統合されています。そのため、これまでの運用を大きく変えることなく、そのまま利用できます。

具体的には、以下の主要な機能も従来通り問題なく動作します。

- vMotion(VM の移行)

- DRS(VM の自動配置)

- HA(障害時の再起動)

メモリが「DRAM + NVMe」という階層構造になっていても、仮想マシンからは従来と同じメモリとして扱われます。そのため、vMotion や DRS、HA といった動作に影響はありません。

また、管理画面や操作方法も基本的にはこれまでと変わらないため、新しい運用手順を大きく作り直す必要もありません。

VMware の戦略:3つの方向性

ここまで紹介してきた Memory Tiering は、単体の機能というよりも、VMware by Broadcom が進めているインフラ最適化の戦略の一部として位置付けられています。

その戦略は、大きく以下の3つの方向性で構成されています。

① ソフトウェアによる最適化

まず1つ目は、ソフトウェアによるリソース効率の最大化です。

- オーバーコミットの最適化

- 可視化・分析によるリソース利用の最適化

従来から vSphere が強みとしてきた領域ですが、ワークロードの特性を可視化し、無駄なリソースを削減することで、既存環境の効率をさらに高めます。

② ハードウェアの活用方法の最適化

2つ目は、ハードウェアの使い方そのものを見直すアプローチです。

- NVMe の活用

- DRAM 依存の削減

Memory Tiering はまさにこの領域に該当し、「高価なメモリだけに依存しない」新しい設計を可能にします。

③ 既存資産の最大活用

3つ目は、既存資産をできるだけ活かすという考え方です。

- 既存ハードウェアでも VCF 9.0 に対応可能なケースが多く、Memory Tiering も導入可能

- 大規模なリプレース不要

新しい機能を利用するために全面的なハードウェア刷新が必要になるのではなく、今ある環境を活かしながら段階的に最適化できる点も大きな特徴です。

まとめ

Memory Tiering は、コスト削減、パフォーマンス維持、既存環境との高い親和性を同時に実現できる、非常に現実的なアプローチです。もし以下のような課題を感じている場合は、Memory Tiering の検討価値が非常に高いと思います。

- メモリ不足でスケールできない

- DRAM コストの増加に悩んでいる

- CPU リソースが余っている

- VDI や仮想基盤の集約率を上げたい

まずは小規模な環境で検証(PoC)などを行い、ワークロードでどの程度効果が出るかを確認してみるのもおすすめです。

別の記事で実際に Memory Tiering を有効化する際の手順を紹介していますので、ぜひこちらもご確認ください。

著者紹介

SB C&S株式会社

ICT事業本部 技術本部 第1技術統括部

第1技術部 1課

山田 和良 - Kazuyoshi Yamada -

VMware vExpert